すでにアウディがサポートを表明、テスラにも?

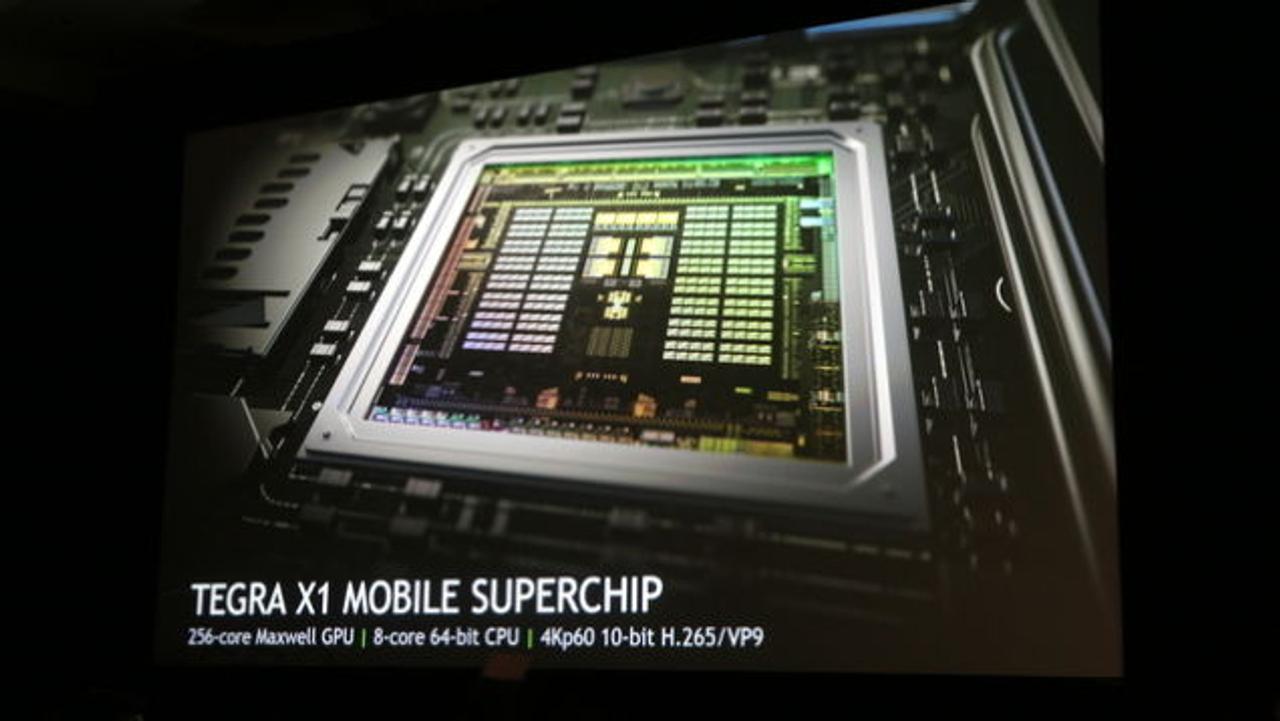

NvidiaがCESで新プロセッサ、Tegra X1(以下X1)を発表しました。去年のCESではデスクトップ用強力グラフィックスチップKeplerをモバイルに持ってきたTegra K1(以下K1)が発表されたんですが、今年のX1ではKeplerの次世代版、Maxwellがモバイルに導入されてます。K1によってNvidia Shield Tabletみたいな、ゲーム専用機並みの性能を持つモバイルタブレットが可能になったんですが、X1はさらに次のレベルに高まってます。Nvidiaいわく、X1のパフォーマンスはK1の2倍で、さらにデスクトップでMaxwellがサポートしているゲームエンジンにもすべて対応できるんです。

つまり、X1搭載ならスマートフォンとかタブレットでもUnreal Engine Elementalのデモみたいなものを動かせるってことです。ただしデモの中のエクストリームなエフェクトは若干カクカクするところがありますが、そもそも動かせるってだけでもとんでもないんです。

X1の登場はゲーム界にも大きなインパクトがありますが、Nvidiaはさらにその先を見据えています。それは、車をコントロールするブレーンを作り出すことです。Nvidiaが「モバイル・コックピット・コンピュータ」と呼ぶDrive CXはX1搭載で、1,660万画素、またはHDのディスプレイ4つを動かせます。つまり車の中できれいな画面4つをいっぺんに動かせて、ダッシュボードがまるでSFの宇宙船みたいになります。こんな感じに。

もうちょっと現実に即していうと、カーナビの画面も従来の適当な地図と矢印みたいなグラフィックスから格段に進化できたりするはずです。またデモでは、車のヴァーチャルパネルのテクスチャや色、素材をその場で変化させていました。

でもNvidiaの野望は単に車載ディスプレイにとどまりません。彼らはX1を自動走行車のブレーンにも搭載させようとしており、「オートパイロット・カー・コンピュータ」と銘打ったDrive PXも発表しました。X1をふたつ搭載するこのチップでは、ディスプレイの表示内容から、ドライバーの目となるカメラから来る情報まで、車周りのすべてを把握できます。それは車に複数搭載したカメラが捉える像の意味を理解する頭脳であり、車やバン、自転車、歩行者がどう見えるかをニューラルネットワーク技術で自律学習していきます。

なんかすごそうだし、実際すごいんですが、実現まではまだまだ時間がかかりそうです。X1の馬力という意味では問題ないはずですが、車側で対応すべきことがたくさんあるんです。たとえばそんなすごいグラフィックスを表示するディスプレイを搭載したり、いくつものカメラを積んだり、そういうことです。さらに今すでにいくつものプレイヤーが自動走行車に取り組んでいるので、そこにこのDrive PXをつなげていくための課題もありそうです。

でもDrive PX自体、技術的にはもうちゃんと動いてます。Nvidiaのプロトタイプはできていて、このまま進めていけば、ぶつかっちゃいけない自転車とか歩行者を見分けたり、前方にブレーキランプがたくさん並んでたら自動で減速態勢に入ったりする賢い車もできるはずです。Nvidiaいわく、彼らが構築するニューラルネットによって、Nvidia搭載車は他のNvidia搭載車と無線で同期しあい、お互いをより賢くすることもできるそうです。

最後に、Nvidiaは自律的に駐車できるAuto Valet機能も紹介しました。これは、車がカメラからの情報を元に自律的に空きスペースを発見し、初めて見る場所であってもつつがなく自動で駐車してくれる機能です。

これらのテクノロジーは、もしかしたら次のテスラの車で見られるかもしれません。NvidiaはテスラのModel Sの巨大タッチスクリーンを動かすプロセッサを供給していますが、今後のことはまだわかりません。でも自動車メーカーではすでにアウディがNvidiaの発表の場に登場して、サポートを表明しています。

Eric Limer - Gizmodo US[原文]

(miho)